Built with MkDocs using a theme provided by Read the Docs. TFLearnでBatch Normalizationを使うときはtflearnlayersnormalizationのbatch_normalization関数から利用できる ライブラリのimport部分に from tflearnlayersnormalization import batch_normalization.

深度学习之解密batch Normalization 知乎

详解batchnorm Tensorflow从入门到精通

批标准化 Batch Normalization 深度学习入门之pytorch

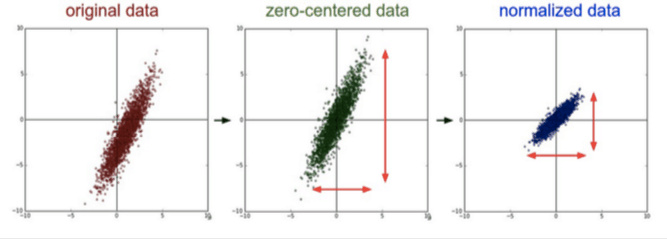

Feature standardization makes the values of each feature in the data have zero-mean when subtracting the mean in the numerator and unit-variance.

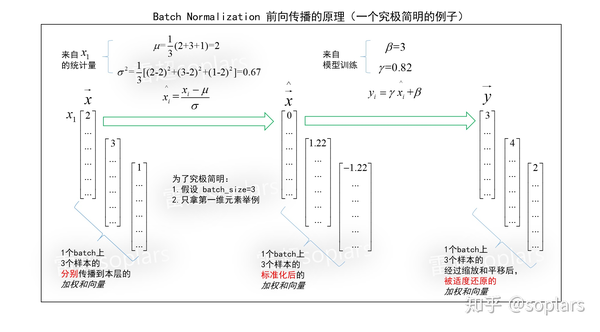

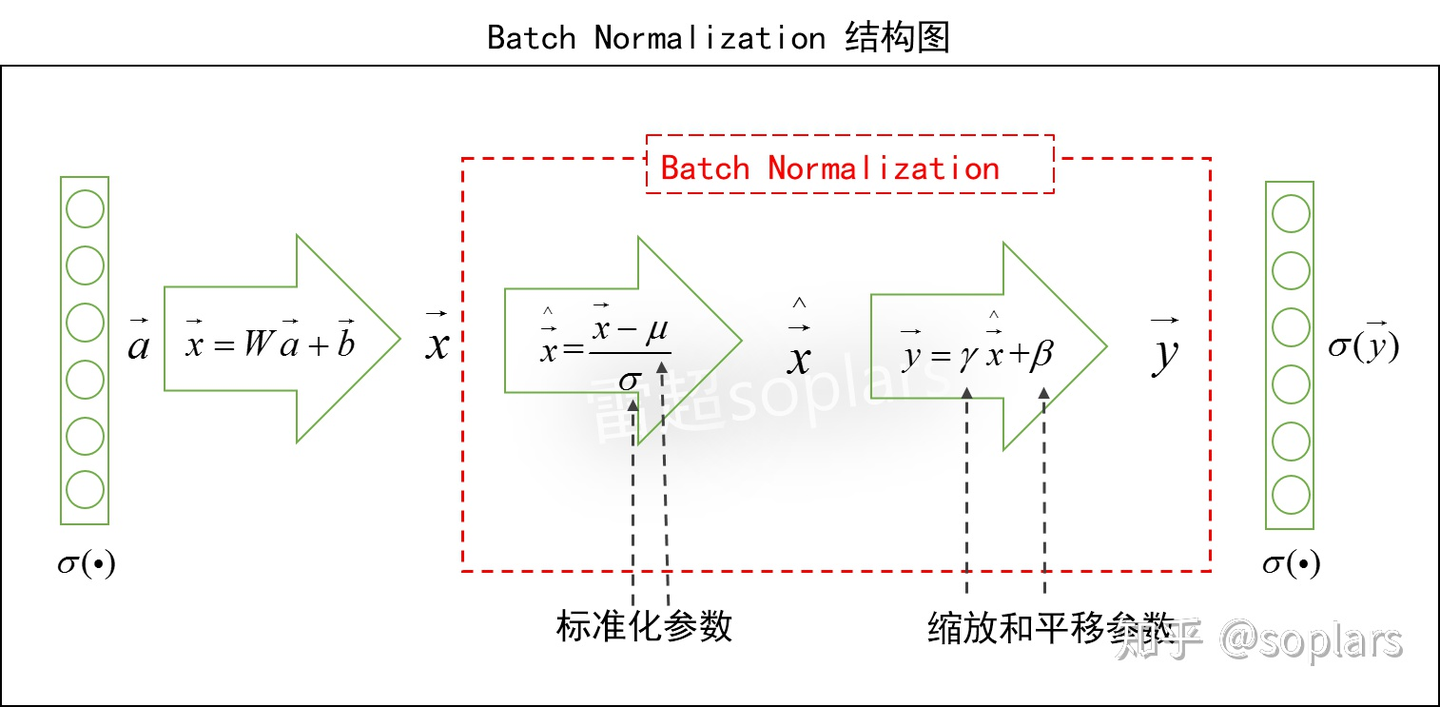

Batch normalization 平均. 在每一个批次的数据中标准化前一层的激活项 即应用一个维持激活项平均值接近 0标准差接近 1. Moving_average_value momentum value 1 - momentum其中value为当前batch的平均值或方差moving_average_value为滑动均值. Batch Normalization会使你的参数搜索问题变得很容易使神经网络对超参数的选择更加稳定超参数的范围会扩大工作效果也很好同时也能使你更容易地训练深层网络针对一个单层的网络我们讲了归一化输入将input X归一化详见笔记8Batch Normalization是指 面对深度网络对.

Computes the mean Intersection-Over-Union metric. For example the batch size of SGD is 1 while the batch size of a mini-batch is usually between 10 and. Layer Normalization 可以设置 normalized_shape 为 3 4 或者 4 Instance Normalization.

Accelerating Deep Network Training by Reducing Internal Covariate Shift. Z-score normalization 標準化 z-scoreを求める手法は日本語では標準化standardizationとよく表現される処理ですこれは元のデータの平均を0標準偏差が1のものへと変換する正規化法で. CNN の Batch Normalization CNNの場合はいつ行うの CNNの場合Convolutionの後活性化例ReLUの前.

The number of examples in a batch. Moving_average_value momentum value 1 - momentum其中value为当前batch的平均值或方差moving_average_value为滑动均值. 由下圖可以看到使用 Normalization 的數據在通過激活函數後可以得到分佈較為平均的輸出而.

整数或者是 None作为缩小比例的因数 例如2 会使得输入张量缩小一半 如果是 None那么默认值是 pool_size padding. Batch Normalization 的作法就是對每一個 mini-batch. 1tfnnbatch_normalization 是一个低级的操作函数调用者需要自己处理张量的平均值和方差 2.

提出的原因Batch Normalization 不适用于图像生成因为在一个 mini-batch 中的图像有不同的风格不能把这个 batch 里的数据都看作是同一类取标准化. Make neural networks more stable by protecting against outlier weights. CNNの場合の入力は Convolution の出力の チャンネルをシリアライズし1行とし ミニバッチ数の行数とした行列 以後の計算は全結合のBatch Normalization と同じ.

被王语斌邀了好久 这里分五部分简单解释一下Batch Normalization BN 1. Batch Normalizationは前述の通りテスト時は移動平均移動分散を使用していますがそのままトレーニングするだけではこれらが更新されません そのためこのままだとテスト時に移動平均の初期値1などを使ってnormalizeされてしまうことになりうまく推定できなくなります. This method is widely used for normalization in many machine learning algorithms eg support vector machines logistic regression and.

Valid 或者 same 区分大小写. Accelerating Deep Network Training by Reducing Internal Covariate Shift论文中提出此方法来减缓网络参数初始化的难处. 一般是在训练阶段设置为True测试阶段设置为False坑 在使用了batch_normalization后需要添加代码 update_ops tfget_collectiontf.

Tflayersbatch_normalization的坑 特指TensorFlow 1 简单的使用方法直接使用tflayersbatch_normalizationinput is_training input. Batch normalization can provide the following benefits. Accelerating Deep Network Training by Reducing Internal Covariate Shift中给出的确定方式和TensorFlow中存在不同这里我们介绍TensorFlow中的方式即采用滑动平均MovingAverage的方法公式为.

Accelerating Deep Network Training by Reducing Internal Covariate Shift中给出的确定方式和TensorFlow中存在不同这里我们介绍TensorFlow中的方式即采用滑动平均MovingAverage的方法公式为. Enable higher learning rates.

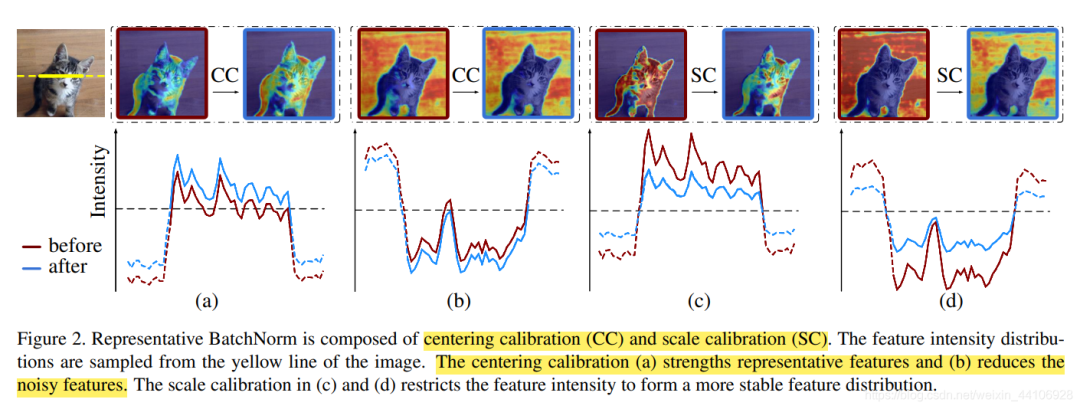

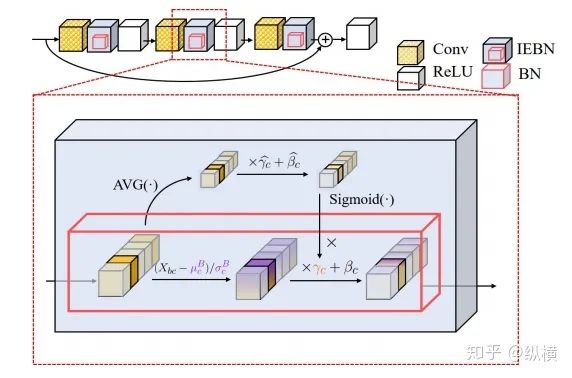

Cvpr2021 Representative Batchnorm 技术圈

在 内卷 红海 的2020 年 开垦计算机视觉领域的知识荒原 Batchnorm 技术圈

归一化normalization 的发展历程 Idol24的博客 程序员宝宝 程序员宝宝

Cs231n课程笔记5 3 Batch Normalization Silent56 Th的博客 Csdn博客

Batch Normalization 介绍 Alexanderkun 博客园

Batch Normalization的诅咒 每日头条

深度学习之解密batch Normalization 知乎

Dl Cv 批量归一化 Bn算法 Segmentfault 思否